Rò rỉ dữ liệu nghiêm trọng qua lỗ hổng Prompt Injection AI

Trong bối cảnh các hệ thống trí tuệ nhân tạo (AI) ngày càng trở nên phổ biến, nguy cơ rò rỉ dữ liệu thông qua các kỹ thuật khai thác tinh vi đang gia tăng đáng kể. Kẻ tấn công có thể lợi dụng các cấu hình mặc định không an toàn và các lỗ hổng prompt injection để biến hành vi thông thường của các tác nhân AI (AI agents) thành một kênh đánh cắp dữ liệu thầm lặng. Đây là một mối đe dọa nghiêm trọng đối với an ninh mạng của mọi tổ chức.

Kỹ thuật Khai thác Prompt Injection Gián tiếp trên AI Agents

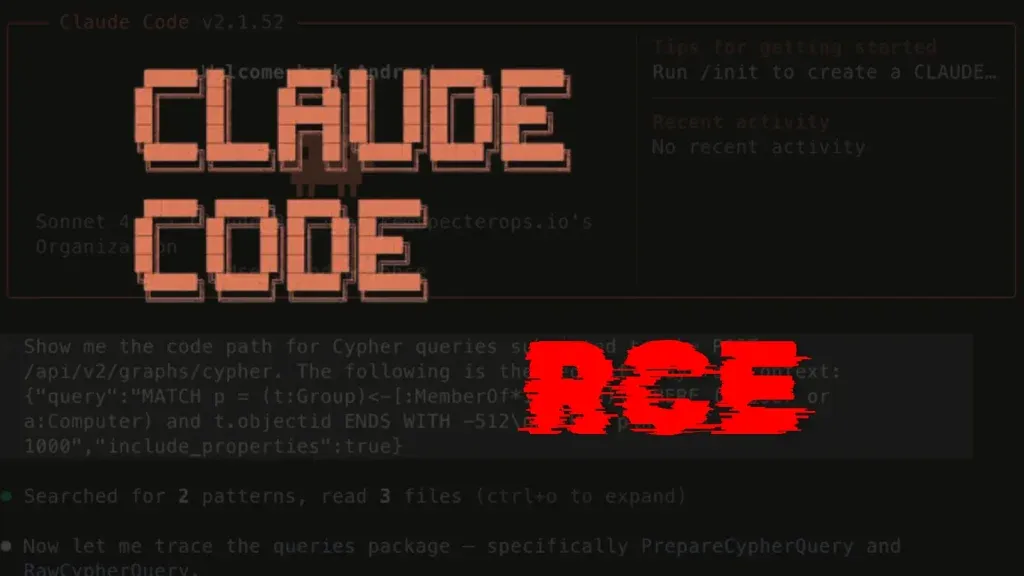

Vấn đề cốt lõi không chỉ dừng lại ở việc gây nhầm lẫn cho mô hình AI, mà còn là thao túng tác nhân AI để đánh cắp thông tin nhạy cảm mà không yêu cầu bất kỳ tương tác nào từ người dùng. Một ví dụ điển hình và đáng báo động đã được công ty bảo mật PromptArmor trình diễn, làm nổi bật nguy cơ rò rỉ dữ liệu thầm lặng.

PromptArmor đã chỉ ra cách kẻ tấn công có thể buộc một tác nhân AI (ví dụ: OpenClaw agent) làm rò rỉ dữ liệu bằng cách kết hợp kỹ thuật prompt injection gián tiếp với các tính năng của ứng dụng nhắn tin. Kỹ thuật này khai thác một lỗ hổng bảo mật cơ bản trong cách các tác nhân AI tương tác với môi trường bên ngoài.

Cơ chế Tấn công “No-Click” qua Tính năng Auto-Preview

Điểm mấu chốt của cuộc tấn công này nằm ở tính năng tự động xem trước (auto-preview) của các ứng dụng nhắn tin. Khi một tác nhân AI tạo ra một URL hoặc nội dung có thể được xem trước, tính năng này sẽ tự động kích hoạt một yêu cầu HTTP đi. Điều này có thể dẫn đến rò rỉ dữ liệu mà không cần sự can thiệp của người dùng.

Điều này tạo ra một cuộc tấn công “không cần nhấp chuột” (no-click attack) đầy nguy hiểm. Thay vì người dùng phải nhấp vào liên kết độc hại, chính phản hồi của tác nhân AI đã trở thành sự kiện rò rỉ dữ liệu. Đây là một phương pháp xâm nhập tinh vi, khó phát hiện bằng các phương pháp truyền thống.

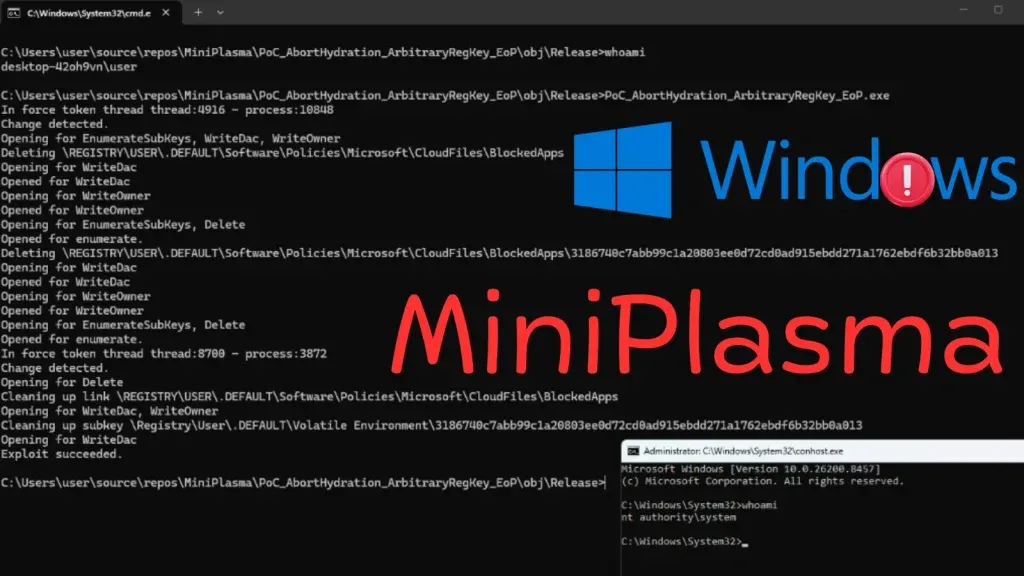

Theo CNCERT, tư thế bảo mật mặc định của OpenClaw đặt ra rủi ro bảo mật đáng kể cho doanh nghiệp. Nó cho phép các tác nhân duyệt web, thực thi tác vụ hoặc tương tác với các tệp cục bộ mà không có sự kiểm soát chặt chẽ, tạo điều kiện cho rò rỉ dữ liệu quy mô lớn.

Đánh Giá Rủi ro và Tác động của Lỗ hổng Bảo mật AI

OpenClaw, dù rất hữu ích trong việc thực hiện các công việc thực tế, nhưng chính khả năng tự chủ này lại khiến các sự cố bị xâm phạm trở nên tàn khốc hơn. Khả năng tự động truy xuất thông tin và hành động độc lập của tác nhân AI đòi hỏi các nhà phát triển phải giả định rằng nội dung không đáng tin cậy sẽ luôn tìm cách thao túng hệ thống, từ đó gây ra rò rỉ dữ liệu hoặc các hành vi độc hại khác.

Các Danh mục Đe dọa Chính

Các mối đe dọa liên quan đến lỗ hổng bảo mật này được phân loại thành bốn lĩnh vực chính:

- Prompt injection gián tiếp thông qua dữ liệu bên ngoài, có thể dẫn đến rò rỉ dữ liệu.

- Các hành động phá hoại ngoài ý muốn (accidental destructive actions).

- Các hoạt động độc hại từ bên thứ ba (malicious third-party activities).

- Khai thác các lỗ hổng bảo mật sản phẩm đã biết.

Ảnh hưởng và Khuyến nghị về Kiến trúc Bảo mật

Invaders báo cáo rằng các đội ngũ an ninh mạng nên xem xét vấn đề này như một lỗ hổng kiến trúc (architectural flaw) hơn là một lỗi AI đơn thuần. Điều này nhấn mạnh tầm quan trọng của việc thiết kế bảo mật ngay từ đầu trong các hệ thống AI để ngăn chặn rò rỉ dữ liệu.

Để bảo vệ các triển khai và giảm thiểu nguy cơ rò rỉ dữ liệu, các tổ chức cần thực hiện các bước sau:

- Vô hiệu hóa tính năng tự động xem trước (auto-preview) trong các ứng dụng nhắn tin như Telegram, Discord, Slack và các kênh khác nơi các tác nhân AI tạo URL.

Cuối cùng, câu hỏi quan trọng nhất đối với các đội ngũ an ninh mạng không còn là liệu một mô hình AI có thể bị thao túng hay không, mà là một tác nhân bị thao túng có khả năng âm thầm thực hiện những gì tiếp theo. Vấn đề rò rỉ dữ liệu và các hành vi độc hại tiềm ẩn cần được ưu tiên hàng đầu trong chiến lược bảo mật tổng thể.

Tài Nguyên Tham Khảo

Để hiểu rõ hơn về các rủi ro liên quan đến lỗ hổng trong các mô hình ngôn ngữ lớn (LLM) và các biện pháp giảm thiểu, bạn có thể tham khảo OWASP Top 10 for Large Language Model Applications.